目录

Gadre S Y, Wortsman M, Ilharco G, et al. Cows on pasture: Baselines and benchmarks for language-driven zero-shot object navigation[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2023: 23171-23181. 哥伦比亚大学 PDF

1. 摘要

介绍了语言驱动的零样本目标导航(L-ZSON)这一任务,即让机器人根据自然语言描述找到任意物体,而不需要在目标物体或领域上进行大量的导航训练。

贡献点:

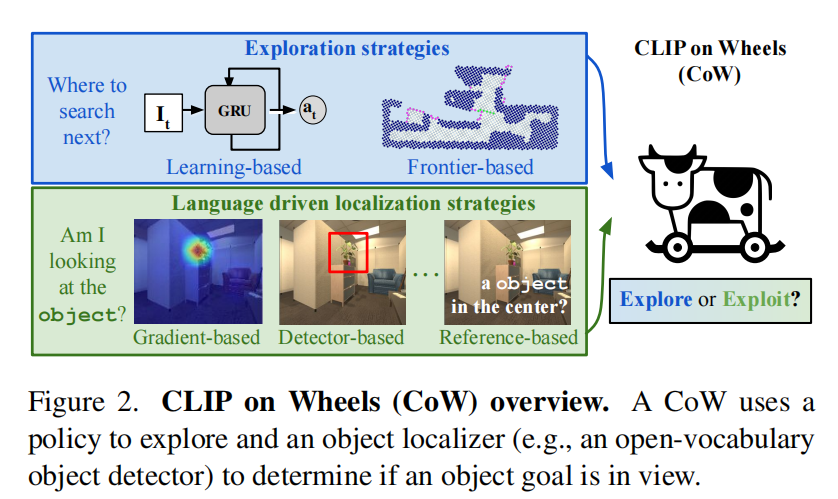

- 该提出了一种简单的基准方法,CLIP on Wheels(CoW),利用开放词汇模型来适应这一任务,无需微调。

- 提出了一个新的评测基准,PASTURE,用于评估CoW和未来方法在L-ZSON上的性能。PASTURE考虑了寻找不常见物体、根据空间和外观属性描述物体、以及寻找隐藏物体等能力。

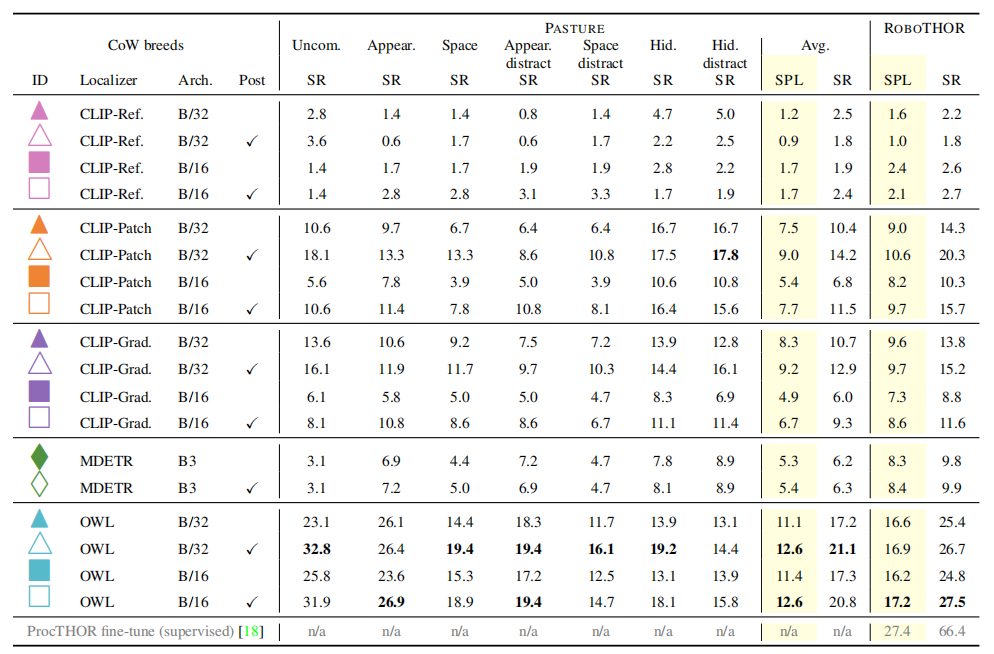

文章通过在HABITAT、ROBOTHOR和PASTURE上部署21种CoW基线,进行了深入的实证研究,并发现CoW基线在寻找不常见物体方面表现出色,但在利用语言描述方面存在不足(指CoW基线在使用自然语言输入来指定目标物体的属性和位置时,没有充分发挥其潜力)。文章还发现一个简单的CoW,在没有额外训练的情况下,在导航效率上达到了一个在HABITAT MP3D数据上训练了5亿步的最先进的ZSON方法的水平,并在ROBOTHOR ZSON模型上提高了15.6个百分点的成功率。

2. 方法

2.1 任务定义

L-ZSON的任务是让一个智能体根据自然语言的描述,在没有显式训练的情况下,找到一个目标物体。

-

让O表示一组目标物体的自然语言描述,可能包含多个属性(例如,“玩具飞机”,“床下的玩具飞机”,或者“木制玩具飞机”)

-

让S表示一组导航场景

-

让p0表示智能体的初始位置

一个导航过程τ∈T可以表示为一个元组τ=(s,o,p0),其中s∈S,o∈O。每个τ都是一个零样本任务,因为这种形式的元组在训练时没有出现过。从p0开始,一个智能体的目标是找到o。智能体接收观察和传感器数据。在每个时间步t,智能体执行一个导航动作a∈A。一个特殊的动作STOP∈A终止了过程。如果智能体距离o小于c单位,并且o满足可见性条件,那么过程就是成功的。

2.2 Cow Baseline

CoW的输入是一个自我中心的RGB-D图像和一个用语言指定的目标物体,每个CoW都有一个探索策略和一个零样本目标定位模块。使用策略来探索,并使用对象定位器(例如,开放词汇表对象检测器)来确定对象目标是否在视图中

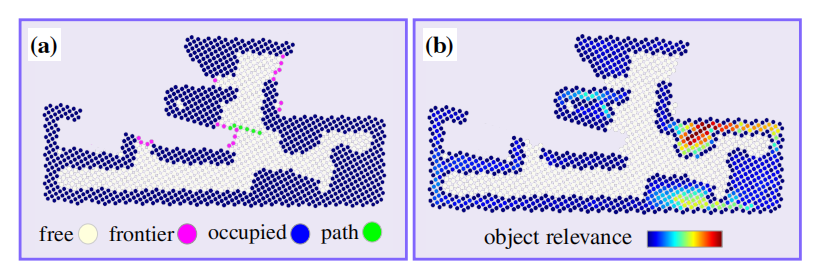

更新一个自顶向下的深度地图:当CoW移动时,它使用RGB-D观察和姿态估计来更新一个自顶向下的世界地图

以自我为中心的深度观测创建自上而下的地图。基于边界的探索规划通往下一个边界的探索路径。当智能体找到一个对象时,将从2D图像中提取的目标相关性区域投影到基于深度的地图中。

探索策略:为了观察场景的不同视角,CoW使用一个策略来探索

- 基于边界的探索:使用一个简单的探索启发式来导航

- 基于学习的探索:采用了一个简单的基于计数的奖励,它是自我监督的探索方法经常试图进行近似

目标定位模块:当CoW探索时,它使用一个目标定位模块和它的自顶向下地图来跟踪对目标物体位置的置信度

- K_Lang:使用k个文本嵌入匹配图像嵌入,文本指定目标对象的位置,例如:a plant in the top left of the image.

- K_Patches:将图像嵌入分割为k份,每一份与文本嵌入做匹配,文本嵌入为目标对象,例如:a plant

- Gradient:采用Chefer等人的方法,利用文本嵌入和视觉主干积累的梯度信息,在图像像素上构建了一个相关性图,从而对目标进行定性分割,归一化后判断真阳性和假阳性。

当CoW的置信度超过一个阈值时,它就计划到达目标的位置,并发出STOP动作。

2.3 The PASTURE Benchmark

为了评价L-ZSON上的Cow基线和未来的方法,该文章引入了PASTURE评价基准。PASTURE建立在机器人验证场景之上,在现实世界中有并行的环境。

PASTURE评估了七种核心的L-ZSON能力:

- 不常见的物体:鉴于家庭中物体的丰富多样性,希望了解导航在不常见物体上的表现

- 外观描述:评估基线能否利用视觉属性

- 空间描述:测试智能体能否利用空间信息进行导航

- 带干扰物的外观描述:为了探究外观属性是否更有助于在干扰物存在时找到目标物体

- 带干扰物的空间描述:为了探究空间属性是否更有助于在干扰物存在时找到目标物体

- 隐藏对象描述:测试目标导航器能否找到隐藏的对象

- 带干扰物的隐藏对象描述:使用之前隐藏对象描述,但重新引入可见实例作为干扰对象

3. 实验

实验环境: PASTURE, ROBOTHOR, HABITAT (MP3D)

导航指标: SR,SPL

Cow Baselines: K_Lang, K_Patches, Gradient, MDERT, OWL_Vit

该工作的最大局限性是缺乏大规模的、真实世界的基准测试(这在许多相关文献中也缺失了)

提供了零样本模型转换为具体化任务的思路和方法,能够促进零样本探索领域的进一步发展。

本文作者:southyang

本文链接:

版权声明:本博客所有文章除特别声明外,均采用 BY-NC-SA 许可协议。转载请注明出处!